在当今科技迅速发展的背景下,人工智能(AI)正逐步渗透到科研的各个领域,带来了前所未有的机遇与挑战。然而,随着AI技术的广泛应用,伦理问题也愈发凸显,这些问题不仅涉及科学研究的道德基础,也关乎社会的整体福祉。

首先,AI在科研中的应用常常依赖于海量数据,这些数据往往涉及个人隐私和敏感信息。如何确保数据收集和使用过程中的透明性与合规性,是一个亟待解决的问题。科研人员需要遵循严格的数据保护法规,以避免侵犯个人隐私权。此外,在处理数据时,如何消除潜在的偏见和歧视,以保证研究结果的公正性,也是伦理考量的重要方面。

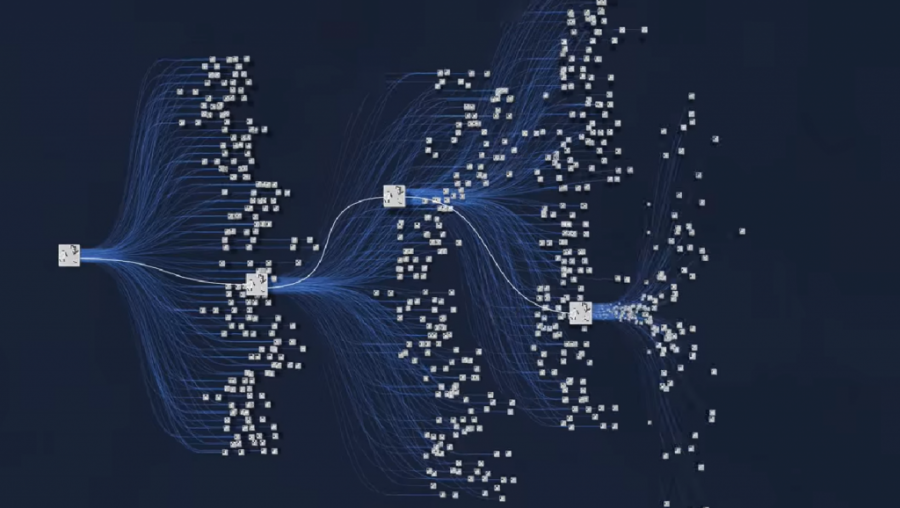

其次,AI系统的决策过程通常缺乏可解释性,这可能导致科研人员对结果产生误解或错误应用。当AI算法生成结论时,其背后的逻辑并不总是清晰可见,这使得研究人员在依赖这些结论时面临风险。因此,提高AI系统的可解释性,使其能够提供透明、易于理解的决策依据,是确保科学研究可信度的重要措施。

此外,AI在科研中的应用还引发了关于责任归属的问题。当AI系统做出错误判断或造成不良后果时,究竟应由谁承担责任?是开发者、用户还是其他相关方?这一问题不仅影响到科研人员对新技术的接受度,也关系到整个社会对AI技术信任度的建立。因此,在推广AI技术之前,有必要明确法律框架和伦理规范,为相关责任提供清晰界定。

最后,科技的发展必须与人类价值观相一致。在推动AI技术进步的同时,我们也要警惕其可能带来的负面影响,包括对就业市场、社会结构以及人际关系等方面造成的不利影响。科学家与政策制定者应共同努力,通过制定合理政策,引导AI技术朝着促进人类福祉、实现可持续发展的方向发展。

综上所述,在人工智能不断深入科研领域之际,我们必须认真审视其带来的伦理挑战。这不仅是为了维护科学研究本身的严谨性与公正性,更是为了构建一个更加公平、透明且富有责任感的科技环境。只有通过积极应对这些伦理考量,我们才能真正发挥人工智能在科研中的潜力,为人类社会创造更大的价值。

客服微信

客服微信

微信公众号

微信公众号